Inhalt dieses Beitrags

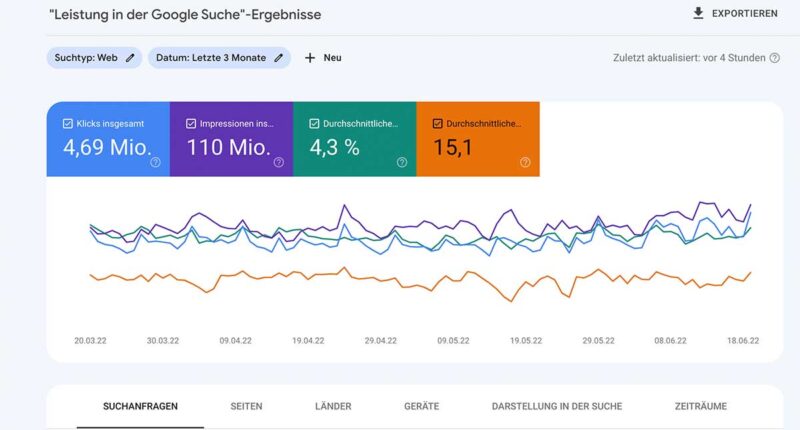

Für die Analyse der organischen Rankings ist die Google Search Console für viele Webmaster und SEOs die beliebteste Datenquelle. Wer wissen möchte welche URL für welche Keywords auf welcher Position rankt, wird in der GSC fündig. Doch leider war es bislang nicht möglich URLs und Keywords in einer Tabelle darzustellen. Im Data Studio gibt es jetzt eine Lösung dafür!

Der Search Console Connector im Data Studio

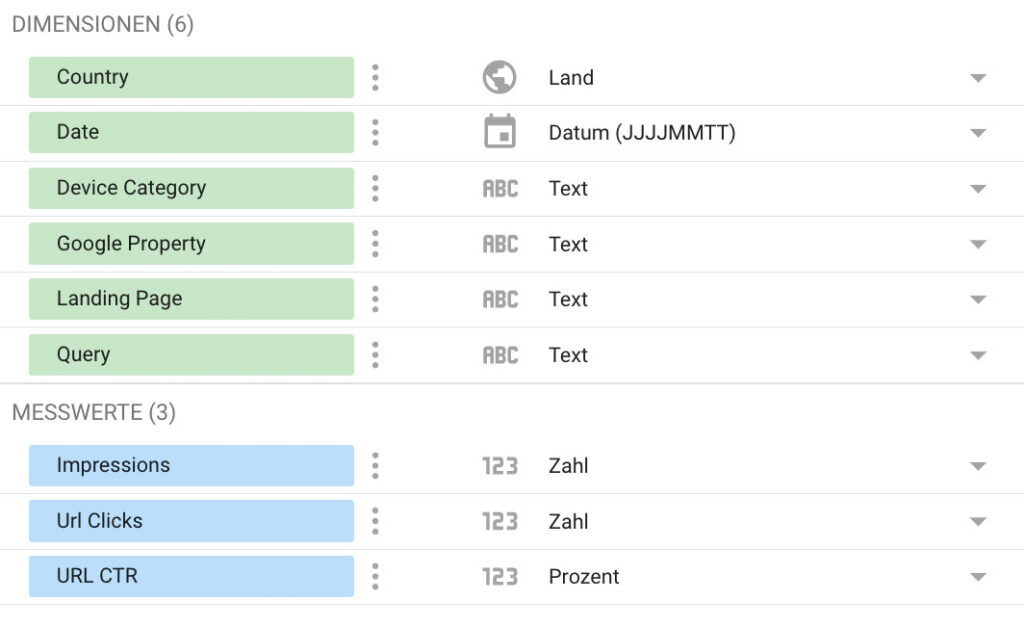

Über den Search Console Connector im Data Studio können die Daten direkt über die Google API gezogen werden. Der Vorteil: es können so mehr als die maximal 1.000 Zeilen exportiert werden. Über die API können zwei Datenquellen verknüpft werden:

- URL-Impressions

- Website-Impressions

In den URL-Impressions gab es bisher zwar die Dimension „Query“ und „Landing Page“, aber nicht den Messwert „Average Position“.

Es war also möglich Keywords und URLs in einer Tabelle darzustellen, allerdings ohne die jeweilige Position. Was der wichtigste Wert aus SEO-Sicht ist!

Was ist neu bei den URL-Impressions?

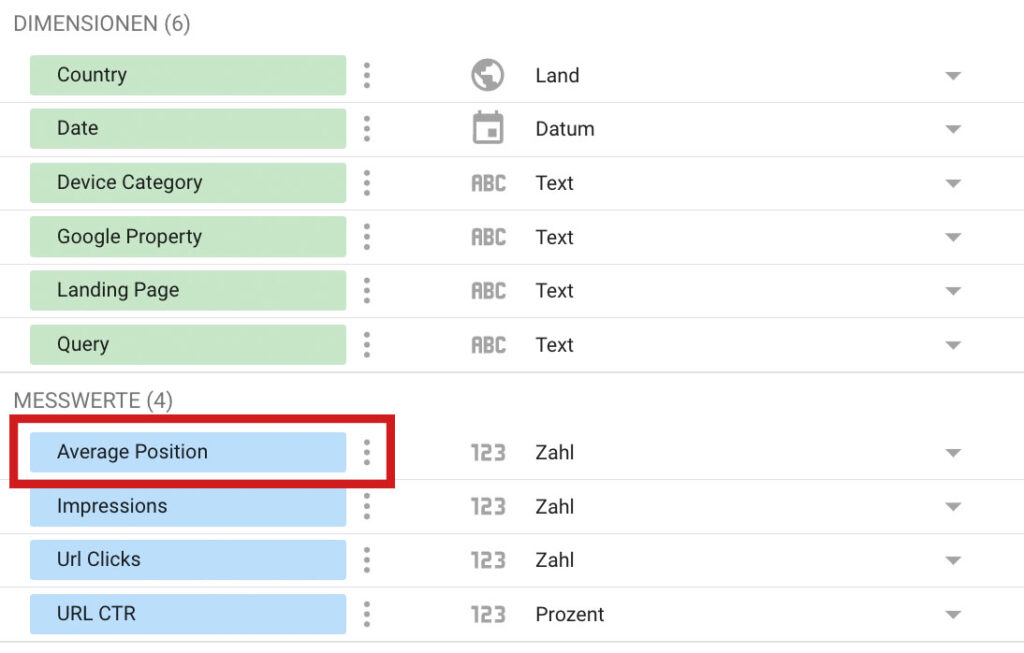

Das hat sich jetzt zum Glück geändert. Seit neuestem gibt es nun auch die „Average Position“ als Messwert in der Datenquelle URL-Impressions.

So kann nun endlich das Ranking eines Keywords für eine bestimmte URL in einer Tabelle analysiert werden. Eine kleine aber bedeutende Änderung im Search Console Connector, mit der nun ein detailliertes Keyword-Monitoring möglich ist.

Warum gibt es überhaupt zwei Datenquellen im Search Console Connector?

Heavy Usern der Google Search Console wird es schon häufiger aufgefallen sein, aber oft stimmen die Daten im Diagramm nicht mit denen in der Tabelle überein.

Woran liegt das?

Im Diagramm und in der Tabelle im Leistungsbericht werden alle Daten nach der Property zusammengefasst. Nur im Reiter Seiten nicht. Hier werden die Daten der jeweiligen Seite zugeordnet.

Ein Beispiel: Ein Nutzer sucht nach „grüne Badehose“ und in den SERPs ranken drei URLs einer Porperty:

- www.xyz./herren-badehosen/

- www.xyz./damen-badehosen/

- www.xyz./kinder-badehosen/

Der Nutzer klickt auf die erste URL, springt zurück in die SERPs und klickt auf die zweite und dritte. Der Property (und dem Keyword „grüne Badehose“) werden 3 Klicks zugeordnet. Den einzelnen URLs nur jeweils 1 Klick.

| Keyword | Klicks | durch. Position |

|---|---|---|

| grüne Badehose | 3 | 1 |

Die durch. Position ist hier 1, weil immer die höchste Position in den SERPs angezeigt wird.

| URL | Klicks | durch. Position |

|---|---|---|

| www.xyz./herren-badehosen/ www.xyz./damen-badehosen/ www.xyz./kinder-badehosen/ | 1 1 1 | 2 |

Die Postion ist hier 2, da die URLs auf den Positionen 1,2 und 3 ranken und somit der Durchschnitt die Position 2 ist.

Auf https://support.google.com/webmasters/answer/7576553?hl=de#zippy=%2Cseiten%2Csuchanfragen im Abschnitt „Daten nach Porperty oder Seiten zusammenfassen“ wird das Messverfahren nochmals genau beschrieben.